使用交互式人工智能(CAI)实现语音转录成本降低高达90%

什么是交互式人工智能(AI)?

交互式人工智能(CAI)使用机器学习(ML)的子集深度学习(DL),通过机器实现语音识别、自然语言处理和文本到语音的自动化。CAI流程通常用三个关键的功能模块来描述:

1. 语音转文本(STT),也称为自动语音识别(ASR)

2 自然语言处理(NLP)

3 文本转语音(TTS)或语音合成

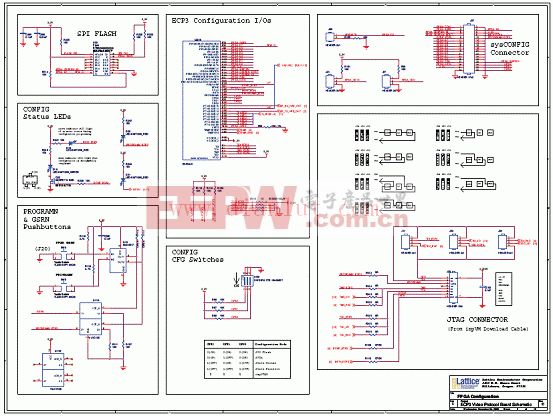

图1:交互式AI构建模块

本篇白皮书详细介绍了自动语音识别(ASR)的应用场景,以及Achronix如何在实现ASR解决方案的同时将相关成本降低高达90%。

细分市场和应用场景

仅在美国就有超过1.1亿个虚拟助手在发挥作用[1],大多数人对使用CAI服务都很熟悉。主要示例包括移动设备上的语音助手,例如苹果的Siri或亚马逊的Alexa;笔记本电脑上的语音搜索助手,例如微软的Cortana;自动呼叫中心应答助理;以及支持语音功能的设备,例如智能音箱、电视和汽车等。

支持这些CAI服务的深度学习算法可以在本地电子设备上进行处理,或者聚集在云中进行远程大规模处理。支持数百万用户交互的大规模部署是一个巨大的计算处理挑战,超大规模的提供商已经通过开发专用的芯片和设备来处理这些服务。

现在,大多数小型企业都可以使用亚马逊、IBM、微软和谷歌等公司提供的云API,轻松地将语音接口添加到他们的产品中。然而,当这些工作负载的规模增加时(本白皮书后面将介绍一个具体的示例),使用这些云API的成本将会变得过高,迫使企业寻求其他解决方案。此外,许多企业运营对数据安全性有更高的要求,因此需要将解决方案必须保留在企业的数据安全范围内。

企业级CAI解决方案可用于以下应用场景:

· 自动呼叫中心

· 语音和视频通信平台

· 健康和医疗服务

· 金融和银行服务

详细介绍ASR处理过程

ASR是CAI流程的第一步,在这里语音被转录为文本。一旦文本可用,就可以使用自然语言处理(NLP)算法以多种方式对其进行处理。NLP包括关键内容识别、情感分析、索引、语境化内容和分析。在端到端的交互式AI算法中,语音合成用于生成自然的语音响应。

最先进的ASR算法是通过端到端的深度学习来实现。不同于卷积神经网络(CNN),递归神经网络(RNN)在语音识别中很常见。正如来自TechTarget [10]的David Petersson在《CNN与RNN:它们有何不同?》文章中提到:RNN更适合处理时间数据,与ASR应用非常适配。基于RNN的模型需要较高的计算能力和存储带宽来处理神经网络模型,并满足交互式系统所需的严格的延迟目标。当实时或自动响应太慢时,它们会显得迟缓和不自然。通常只有牺牲处理效率才能实现低延迟,这会增加成本,并且对于实际部署来说会变得过于庞大。

Achronix与采用现场可编程逻辑门阵列(FPGA)进行AI推理的专业技术公司展开合作。利用其MAU推理加速引擎在FPGA上实现基于RNN的高性能网络。该设计已集成到Achronix Speedster®7t AC7t1500 FPGA器件中,可以利用Speedster7t架构的关键架构优势(将在本白皮书后面进行探讨),大幅提高实时ASR神经网络的加速处理,从而与服务器级中央处理器(CPU)相比,可处理的实时数据流(RTS)的数量增加2500%。联系Achronix。

参考资料:

1. https://www.statista.com/statistics/973815/worldwide-digital-voice-assistant-in-use/

2. https://www.microsoft.com/en-us/research/project/project-brainwave/

3. Myrtle.ai未发表的白皮书,关于在Speedster AC7t1500器件中托管的ASR应用

4. M. Langhammer, G. Baeckler和S. Gribok,《SpiderWeb-高性能FPGA NoC》,2020 IEEE国际并行和分布式处理研讨会(IPDPSW),2020年,第115-118页,doi:10.1109/IPDPSW50202.2020.00025。

5. https://arxiv.org/pdf/2010.06075.pdf

6. https://aws.amazon.com/transcribe

7. https://cloud.google.com/speech-to-text

8. https://www.ibm.com/cloud/watson-speech-to-text

9. https://docs.microsoft.com/en-us/azure/cognitive-services/speech-service

评论